APPRENTISSAGE PROFOND ou DEEP LEARNING

Article modifié le

Réseaux de neurones formels

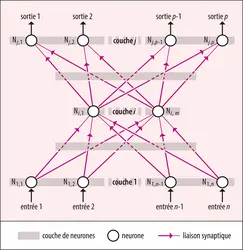

L’histoire des réseaux de neurones formels remonte à 1943, avant même la construction des premiers ordinateurs électroniques, alors que l’on commence seulement à fabriquer des calculateurs électromécaniques au moyen de relais téléphoniques. L’idée de dresser un parallèle entre ces machines et le cerveau humain traverse les pensées du mathématicien américain Walter Pitts (1923-1969) qui, âgé d’à peine vingt ans à l’époque, écrit avec le neurophysiologiste américain Warren McCulloch (1898-1969), un article intitulé « A logical calculus of immanent ideas in nervous activity »(« Un calculateur logique des idées immanentes dans l'activité nerveuse »). Ils y établissent une analogie entre, d’un côté, ces relais téléphoniques et les cellules du cerveau – les neurones – et, d’un autre côté, les connexions entre ces relais téléphoniques et les liaisons dites synaptiques qui relient les neurones entre eux. Pour résumer ces analogies, on appelle « neurones formels » ces relais téléphoniques, et « synapses formelles » leurs connexions. Afin de mimer les phénomènes biologiques dits de « plasticité synaptique » qui affectent la plus ou moins grande connectivité de l’influx nerveux entre les neurones et qui se trouvent à l’origine de l’apprentissage physiologique, on module les synapses formelles d’un nombre plus ou moins grand que l’on appelle le « poids synaptique » et qui joue sur l’intensité de la transmission d’information entre les neurones formels.

Outre la description de cette analogie, McCulloch et Pitts démontrent qu’en organisant ces neurones formels en trois couches, et en connectant les neurones formels de chaque couche avec des neurones formels de la couche suivante par des synapses formelles dont on ajuste correctement les poids synaptiques, on peut réaliser n’importe quelle fonction logique. Ce théorème d’universalité est essentiel.

Accédez à l'intégralité de nos articles

- Des contenus variés, complets et fiables

- Accessible sur tous les écrans

- Pas de publicité

Déjà abonné ? Se connecter

Écrit par

- Jean-Gabriel GANASCIA : professeur des Universités, faculté des sciences, Sorbonne université, Paris

Classification

Média

Autres références

-

APPRENTISSAGE, psychologie

- Écrit par Daniel GAONAC'H et Jean-François LE NY

- 5 940 mots

- 2 médias

Ces recherches s’articulent maintenant avec celles qui, en intelligence artificielle, s’appuient surl’exploitation d’un très grand nombre de données empiriques (big data) : plutôt que d’« instruire » la machine par des règles définies a priori, on cherche à ce que celle-ci se fonde, pour... -

BIG DATA

- Écrit par François PÊCHEUX

- 6 148 mots

- 3 médias

...les progrès réalisés dans le domaine de l’apprentissage automatique (machine learning), encore appelé apprentissage statistique, et de son extension, l’apprentissage profond (deeplearning), qui excelle dans la reconnaissance vocale, la reconnaissance d’images, ou encore le traitement automatique... -

DÉTERMINATION DE LA STRUCTURE 3D DES PROTÉINES

- Écrit par Emmanuelle NEUMANN , Beate BERSCH et Juan FONTECILLA-CAMPS

- 7 097 mots

- 5 médias

...depuis longtemps, des scientifiques réfléchissent et travaillent sur la prédiction des structures de protéines à partir de leurs séquences. En 2021, un algorithme, nommé AlphaFold et développé par DeepMind, a surpassé tous les autres algorithmes de prédiction de structures 3D des protéines ; il révolutionne,... -

EXPÉRIENCE (notions de base)

- Écrit par Philippe GRANAROLO

- 2 783 mots

...conduisent certains de nos contemporains à « humaniser » nos machines en leur prêtant la capacité d’acquérir de l’expérience ? L’apparition récente du deeplearning tend à rapprocher le fonctionnement mécanique du fonctionnement biologique. Prenons l’exemple de la reconnaissance des formes. Pour « apprendre... - Afficher les 12 références

Voir aussi