INFORMATIQUE Ordres de grandeur

Article modifié le

La puissance de calcul et l'intelligence

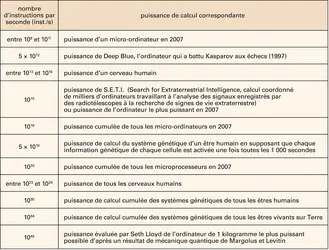

Le bit d'information et l'octet qui s'en déduit sont des unités précises et claires. La difficulté qu'il y a de savoir le nombre exact de CD ou de DVD dans le monde (parmi ceux qui ont été produits, combien ont été détruits ?) et le nombre exact de disques durs (même problème) introduit une incertitude dans le décompte de l'information numérique totale, mais elle est peu importante. En revanche, dans le domaine de la mesure de la puissance de calcul, l'imprécision des chiffres est plus grande car aucune unité de calcul absolue et praticable n'est définie. Diverses unités de bases sont utilisées pour mesurer la puissance des ordinateurs : nombre d'opérations binaires par seconde, nombre de bits utiles calculés par seconde, nombre d'instructions exécutées chaque seconde, nombre de cycles par seconde du microprocesseur, nombres d'opérations en virgule flottante effectuées par seconde. Cela conduit aux unités courantes que sont le MIPS (million d'instructions par secondes), le gigaflops (milliard d'opérations en virgule flottante par seconde), le gigahertz (milliard de cycles par secondes), etc. Il est délicat de convertir ces unités les unes en les autres. Cependant, si on accepte une certaine imprécision, on peut ramener toutes les unités de puissance de calculs proposées en informatique à une seule. C'est ce que nous avons pris le risque de faire pour arriver au tableau 2, qui présente les puissances de calcul de notre technologie actuelle.

Nous y avons inséré quelques données portant sur les êtres vivants. Celles-ci sont particulièrement délicates à établir, en particulier dans le cas de l'évaluation, en instructions par seconde, de la puissance du cerveau humain, pour lequel nous proposons une très large fourchette (entre 1013 et 1019) car les diverses études concordent mal et sont fondées sur des raisonnements peu sûrs. De tels chiffres doivent être considérés avec prudence, car le cerveau est très différent d'un ordinateur : il n'est pas certain qu'en utilisant le type d'architectures mis en œuvre aujourd'hui dans nos ordinateurs nous puissions, quelle que soit la puissance de ces architectures, égaler les performances du cerveau humain. Même si 1020 calculettes étaient connectées les unes aux autres, nous n'aurions pas créé un être intelligent ! Pour arriver à créer un être artificiel intelligent – si cela est possible –, il faut vraisemblablement de la puissance de calcul, mais aussi une architecture adaptée et des logiciels spécifiques. Ces derniers ingrédients aujourd'hui font défaut, et même si des chercheurs y travaillent, rien ne permet sérieusement de prévoir quand ils réussiront ni même s'ils réussiront. La puissance nominale n'est pas tout et ce n'est pas parce qu'en 2020 ou 2050 nous saurons construire des micro-ordinateurs égalant la puissance de calcul d'un cerveau humain que nous aurons créé une intelligence artificielle.

La complexité de nos ordinateurs et leur puissance donnent le vertige. Il faut cependant réaliser, comme à propos de la mémoire, que le monde vivant met en œuvre un système de traitement de l'information (et donc de calcul), qui dépasse de beaucoup celui dont nous disposons avec nos dispositifs électroniques. En instructions par seconde, la puissance cumulée de calcul artificiel sur Terre atteint environ 1020. De son côté, la puissance cumulée de calcul du monde vivant dépasse largement 1030. C'est donc plus de dix ordres de grandeur qui devraient être franchis pour que le monde électronique rattrape le monde génétique. En supposant que la loi de Moore reste valide tout le temps nécessaire – ce qui est peu vraisemblable –, il faudrait attendre cinquante ans. On peut aussi remarquer que le monde vivant, qui dispose d'un[...]

La suite de cet article est accessible aux abonnés

- Des contenus variés, complets et fiables

- Accessible sur tous les écrans

- Pas de publicité

Déjà abonné ? Se connecter

Écrit par

- Jean-Paul DELAHAYE : professeur à l'université des sciences et technologies de Lille

Classification

Médias

Autres références

-

PHYSIQUE - Physique et informatique

- Écrit par Claude ROIESNEL

- 6 760 mots

La révolution informatique est de nature technologique. Les physiciens sont associés à toutes les étapes de son développement. Les technologies incorporées dans les premiers ordinateurs avaient été inventées pour les besoins de la recherche en physique nucléaire. Le convertisseur analogue-digital,...

-

AFFICHE

- Écrit par Michel WLASSIKOFF

- 6 818 mots

- 12 médias

Dansles années 1990, l'affiche est de plus en plus souvent conçue sur écran, la publication assistée par ordinateur (P.A.O.) permettant l'association des textes et des images. La mise au point du langage Postscript conduit à la création de caractères haute résolution et le dessin de lettres connaît... -

AIKEN HOWARD HATHAWAY (1900-1973)

- Écrit par Bernard PIRE

- 506 mots

L’Américain Howard Aiken fut un des pionniers de l'informatique, concepteur de l'IBM Automatic Sequence Controlled Calculator (ASCC) encore appelé Harvard Mark I.

Après avoir suivi les cours d'une école technique tout en travaillant la nuit, Howard Hathaway Aiken, né le 9 mars 1900 à...

-

ALGORITHME

- Écrit par Alberto NAIBO et Thomas SEILLER

- 5 919 mots

- 4 médias

La notion d’algorithme a envahi nos discours et nos pratiques, en raison surtout de la diffusion massive d’applications informatiques dédiées à l’exécution automatisée de certaines tâches, ou à la résolution de certains problèmes. On trouve en effet les algorithmes non seulement dans de nombreux domaines...

-

APPLE

- Écrit par Pierre MOUNIER-KUHN

- 2 548 mots

- 2 médias

Archétype des start-up de la Silicon Valley, la société américaine Apple, fondée en 1976, a gagné fortune et célébrité par ses innovations de rupture, de l’ordinateur Macintosh au téléphone portable iPhone et à la tablette numérique iPad. Associée au talent visionnaire de son président historique,...

- Afficher les 148 références

Voir aussi