- 1. Convergences usuelles en analyse

- 2. Représentations par des intégrales

- 3. Représentations par des séries

- 4. Approximation par des suites

- 5. Interpolation et discrétisation

- 6. Opérations sur les représentations et les approximations

- 7. Stabilité et consistance

- 8. Optimisation de l'approximation ; rapidité de convergence

- 9. Bibliographie

FONCTIONS REPRÉSENTATION & APPROXIMATION DES

Article modifié le

Interpolation et discrétisation

Position du problème

Ce sont les problèmes de tabulation numérique des fonctions transcendantes élémentaires (lignes trigonométriques, logarithmes) et, à partir du xviie siècle, le calcul approché des intégrales et des dérivées qui ont été à l'origine du développement des méthodes interpolatoires. D'autre part, dans de nombreux phénomènes continus intervenant en sciences physiques, décrits par exemple à l'aide d'une fonction, on ne connaît les valeurs de cette fonction qu'en un certain nombre de points qui correspondent aux mesures effectuées. Les problèmes issus de l'astronomie, en particulier la détermination de la trajectoire des planètes, ont aussi joué un rôle moteur, comme en témoignent notamment les travaux d'Euler, Lagrange, Legendre, Laplace et Gauss.

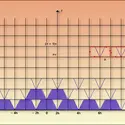

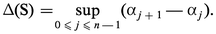

Dans tous les cas, le phénomène continu est remplacé par un phénomène discret. Plus précisément, supposons que le phénomène continu est décrit par une fonction numérique f d'une variable réelle. On se donne une subdivision S de l'intervalle [α, β], c'està-dire une suite croissante (α0, α1, ..., αn) de points de [α, β] ; le module de la subdivision S est le nombre :

Lorsque α0 = α, αn = β et, pour tout j, αj+1 − αj = (β − α)/n, on dit que la subdivision est à pas constant, et Δ(S) = (β − α)/n s'appelle le pas de S.

Dans ces conditions, on associe à S la suite finie (f (α0), ..., f (αn)). Nous dirons qu'il s'agit d'une discrétisation de f (cf. analyse numérique). Le problème est alors de savoir dans quelle mesure on peut reconstituer f à partir des phénomènes discrétisés associés. À cet effet, on interpole la suite précédente par une fonction simple, par exemple une fonction polynomiale que nous noterons PS(f ), de degré ≤ n, prenant aux points αj les mêmes valeurs que f. Dans le cas où S est à pas constant, cette méthode a été élaborée dès le xviie siècle, notamment par Newton et Gregory, dans le cadre du calcul des différences finies (cf. infra). L'étude du cas général a été ébauchée par Newton et reprise par Lagrange, Cauchy et Hermite.

Il s'agit alors d'estimer la différence f − PS(f ), par exemple en majorant N∞(f − PS(f )), et d'étudier l'influence de la taille de l'intervalle [α, β], du choix de S et de la régularité de f sur la qualité de l'approximation. Il arrive souvent qu'on ne s'intéresse pas directement à f mais à la valeur d'une forme linéaire sur f. Pour ce type de problème, d'autres normes s'imposent : norme N1 pour les intégrales, normes f ↦ N∞(f ) + N∞(Df ) pour les dérivées. Dans les phénomènes physiques, les normes N2 interviennent souvent au titre de l'énergie.

On peut aussi se demander s'il est possible de reconstituer f comme limite de fonctions PS(f ) en raffinant les subdivisions, c'est-àdire en faisant tendre le module Δ(S) vers 0. Mais cette question présente des difficultés (cf. infra, Interpolation polynomiale). C'est pourquoi on a recours à un procédé plus élaboré : on se donne f sur un intervalle[a, b], on découpe cet intervalle en p intervalles de longueur (b − a)/p et, sur chacun de ces intervalles notés [α, β], on approche f par PS(f ). Le problème est alors de savoir comment on peut jouer sur les entiers n et p pour obtenir des approximations efficaces. Dans ce schéma plus élaboré, f est approchée sur[a, b]par une fonction ϕ continue et polynomiale par morceaux. On peut imposer en outre à ϕ des conditions de régularité plus fortes aux p − 1 points de subdivision de[a, b], ce qui conduit par exemple à la théorie des fonctions spline (cf. infra, Interpolation polynomiale par morceaux). Les méthodes de discrétisation s'appliquent aussi à la recherche de solutions approchées d'équations différentielles, grâce à l'emploi d'équations aux différences finies (cf. équations différentielles, chap. 7) ; plus récemment, le développement des calculs sur ordinateurs a permis de les appliquer avec succès aux équations aux dérivées partielles (cf. équations aux dérivées partielles - Analyse numérique, chap. 1).

Nous commencerons par décrire les principales méthodes d'interpolation polynomiale et nous aborderons ensuite l'interpolation par les fonctions polynomiales par morceaux.

Interpolation polynomiale

Interpolation de Lagrange

Étant donné un élément b = (β0, ..., βn) ∈ Cn+1, on veut étudier les polynômes P à coefficients complexes tels que, pour tout j,

À cet effet, on introduit l'application linéaire u : C[X] → Cn+1 qui à tout polynôme P associe (P(α0), ..., P(αn)). Les équations (1) s'écrivent alors sous la forme :

Le noyau de u est constitué des polynômes P qui s'annulent en tout point αj, c'est-à-dire qui sont divisibles par :

Ce polynôme N, dont la donnée équivaut à celle du système S, joue un rôle fondamental dans la théorie de l'interpolation ; on l'appelle le noyau interpolateur associé à S. Le théorème de division euclidienne des polynômes montre que C[X] = Keru ⊕ En, où En est l'espace vectoriel des polynômes de degré ≤ n.

L'application linéaire u induit un isomorphisme de En sur Cn+1. Ainsi, il existe un polynôme Pb de degré ≤ n et un seul tel que, pour tout j, on ait Pb(αj) = βj. Les solutions de (1) sont alors les polynômes P de la forme P = Pb + QN, où Q ∈ C[X].

En particulier, pour tout i, il existe un polynôme Li de En et un seul tel que :

Dans ces conditions, on a :

Soit maintenant f une fonction continue à valeurs complexes sur [α, β], et b = (f (α0), ..., f (αn)) ; le polynôme Pb s'appelle le polynôme d'interpolation de Lagrange de f associé à S et se note LS(f ). Ainsi, LS(f ) est l'unique polynôme de degré inférieur à n tel que, pour tout j,

En outre, l'application uS : f ↦ LS(f ) est un projecteur de C([a, b]) sur le sous-espace vectoriel En.

On peut estimer la précision de l'approximation de f par LS(f ), grâce au théorème de division des fonctions différentiables (cf. supra) ; on démontre que, si f est de classe Cn+1 sur [α, β], alors, pour tout t ∈ [α, β], on a la majoration :

Ces majorations ne peuvent pas être améliorées, car (8) et (9) sont des égalités lorsque f est le noyau interpolateur N.

Supposons maintenant que f est de classe C∞ ; donnons-nous une suite (Sn) de subdivisions telle que Δ(Sn) → 0 et notons plus simplement Ln(f ) le polynôme interpolateur de f associé à Sn. Dans ces conditions :

Pour étudier la convergence de Ln(f ) vers f, on observe que :

Pour remédier à ce défaut, on peut essayer de choisir les subdivisions Sn de telle sorte que ∥Nn+1∥∞ soit minimale, ce qui a lieu lorsque Nn est le n-ième polynôme Tn de Tchebychev. Pour [α, β] = [− 1, + 1], on a :

Cependant, cette convergence n'a pas lieu pour toutes les fonctions continues. En effet, d'après un théorème de Faber, quelle que soit la suite (Sn), il existe une fonction continue f telle que ∥Ln(f )∥∞ tende vers + ∞. Ce résultat est un des exemples cités par Banach et Steinhaus comme étant à l'origine du théorème qui porte leur nom (cf. espaces vectoriels normés, chap. 4).

Interpolation de Hermite

Il s'agit du cas plus général où l'on impose au polynôme interpolateur des contacts d'ordre donné avec la fonction f aux points αj. On se donne cette fois une suite (α0, ..., αr) de points de [α, β], et une suite (n0, ..., nr) d'entiers strictement positifs. On pose :

Lorsque f est de classe Cn+1 sur [α, β], il existe un polynôme LS(f ) de degré ≤ n et un seul tel que, pour tout j, 0 ≤ j ≤ r, et tout k, 0 ≤ k ≤ nj − 1, on ait :

En outre, pour tout t ∈ [α, β],

Le polynôme LS(f ) est le polynôme d'interpolation de Hermite associé à S. Le cas de Lagrange correspond à nj = 1, tandis que la formule de Taylor correspond à r = 1 et n0 = n + 1, c'est-à-dire :

Dans le cas où nj = 2, c'est-à-dire :

Différences divisées

L'expression du polynôme interpolatoire de Lagrange (formule (7)) a l'avantage de faire intervenir de manière symétrique les points de subdivision, mais elle est mal adaptée au calcul numérique, d'autant plus que l'adjonction de points interpolateurs supplémentaires oblige à recommencer entièrement les calculs. Newton avait procédé en utilisant une autre base de l'espace vectoriel des polynômes de degré ≤ n, à savoir D0 = 1, D1 = X − α0, D2 = (X − α0)(X − α1), ..., Dn = (X − α0) ... (X − αn-1) ; ici la matrice de passage de la base canonique 1, X, ..., Xn à cette base est beaucoup plus simple que dans le cas de Lagrange car elle est triangulaire.

Pour obtenir la décomposition dans cette base du polynôme interpolateur LS(f ), on introduit les différences divisées de f relatives à S, définies par les relations de récurrence :

Dans ces conditions, on a la formule :

En outre, le reste est donné par la relation :

L'adjonction à S d'un point supplémentaire ne modifie pas les différences divisées précédentes. En outre, la différence divisée Fj est une fonction symétrique de α0, ..., αj, car :

Subdivisions à pas constant

Lorsque S est une subdivision de [α, β] à pas constant h = (β − α)/n, il est commode d'étudier d'abord le cas où h = 1 et α = 0, et donc β = n − 1 ; le noyau interpolateur s'écrit alors :

Pour calculer le polynôme interpolateur LS(g), où g est définie sur [0, n − 1], on introduit l'opérateur de Bernoulli Δ, à savoir l'endomorphisme de C[X] défini par la relation :

L'étude de cet endomorphisme conduit à introduire une base de C[X] adaptée à Δ, définie par les relations de récurrence :

Ces polynômes sont donnés par les relations :

Les polynômes Np s'appellent polynômes de Newton ; on remarquera que Np = (1/p !) Dp. Dans ces conditions, tout polynome P se décompose sous la forme :

Appliquant la relation (19) à LS(g), on obtient :

Le calcul des différences successives dites non divisées (Δpg)(0) est très facile. Le cas d'une fonction f définie sur [α, β] se ramène au cas précédent par changement de variable affine, en introduisant g(u) = f (α + (β − α)u).

On peut développer une théorie entièrement analogue en introduisant à côté de l'opérateur de Bernoulli progressif Δ, l'opérateur régressif ∇ défini par :

Les opérateurs Δ, ∇ et δ peuvent s'exprimer à l'aide des opérateurs de translation :

Généralisations

Le problème de l'interpolation se pose aussi pour les fonctions périodiques, auquel cas les fonctions polynomiales sont remplacées par des polynômes trigonométriques. Ces deux exemples se placent dans la théorie générale des systèmes de Tchebychev : on se donne un sous-espace En de dimension n + 1 de l'espace C([α, β]) qui est régulier, c'est-à-dire tel que tout élément de En qui s'annule en au moins n + 1 points est nul. Étant donné une base ϕ0, ϕ1, ..., ϕn de En, on interpole f par une combinaison linéaire de ces fonctions. On peut montrer, en particulier, que l'espace vectoriel des solutions d'une équation différentielle linéaire sans second membre d'ordre n + 1 est régulier.

Interpolation polynomiale par morceaux

Théorie classique

On considère cette fois une fonction f continue sur un intervalle[a, b], que l'on découpe en p intervalles[tj, tj+1]de longueur (b − a)/p et, sur chacun de ces intervalles, on effectue une interpolation de Lagrange ou de Hermite de f, par des polynômes de degré ≤ n. En pratique, n est fixé et assez petit pour éviter les phénomènes du type de Runge. Il s'agit alors d'étudier la convergence de la suite (ϕp) des fonctions polynomiales par morceaux ainsi obtenues vers la fonction f et la rapidité de convergence en fonction de la régularité de f.

Voici les deux exemples les plus importants.

1. Fonctions en escalier. Sur chaque intervalle[tj, tj+1], on approche f par une constante, par exemple f (tj) ; ici n = 0. Grâce à la continuité uniforme de f sur[a, b], on montre aussitôt que les fonctions en escalier ainsi obtenues convergent uniformément vers f sur[a, b].

En outre, si f est lipschitzienne sur[a, b], alors :

2. Fonctions affines par morceaux. Sur chaque intervalle[tj, tj+1], on effectue une interpolation linéaire de f. On montre encore que les fonctions affines par morceaux ϕp ainsi obtenues convergent uniformément vers f sur[a, b]. En outre, si f est lipschitzienne de rapport k sur[a, b], on a :

Mais, cette fois, si f est de classe C1, la rapidité de convergence est meilleure. Par exemple, si f ′ est lipschitzienne,

Dans certains problèmes, comme le calcul approché des intégrales (cf. analyse numérique, chap. 2), on est amené à interpoler f par des fonctions polynomiales par morceaux de degré n plus élevé. Lorsque f est de classe Cn+1, on a alors :

On constate ainsi que la rapidité de convergence est gouvernée par la régularité de f.

Fonctions spline

Lorsque n ≥ 2, le procédé précédent présente de nombreux inconvénients, car on approche des fonctions régulières f par des fonctions qui ne sont même pas de classe C1. Il est donc intéressant d'approcher f par des fonctions ϕ satisfaisant aux deux conditions suivantes :

a) Sur chaque intervalle[tj, tj+1], la fonction ϕ est polynomiale de degré ≤ n ;

b) Sur[a, b], la fonction ϕ est de classe Cn-1 (conditions de recollement aux points tj).

De telles fonctions sont appelées spline (tringle souple). L'espace vectoriel Sn([a, b]) de ces fonctions est de dimension n + p. Si on impose maintenant les p + 1 conditions interpolatoires relatives à la fonction f :

c) Pour tout j, 0 ≤ j ≤ p, on a l'égalité ϕ(tj) = f (tj), il reste n − 1 paramètres encore libres.

Le cas n = 2 (fonctions paraboliques par morceaux) ne conduit pas à une théorie intéressante car il ne reste qu'un seul paramètre, ce qui ne permet pas d'imposer une condition de contact aux deux extrémités de l'intervalle[a, b]. Au contraire, le cas n = 3 (fonctions spline cubiques) convient bien car il permet d'imposer la condition :

d) ϕ′(a) = f ′(a) et ϕ′(b) = f ′(b).

Les fonctions spline cubiques conviennent aussi pour l'interpolation des fonctions périodiques. Dans ce cas, on impose à ϕ de se prolonger en une fonction périodique de classe C2 sur R, ce qui conduit à remplacer la condition (d) par :

d′) D+ϕ(a) = D-ϕ(b) et D2+ϕ(a) = D2-ϕ(b), en désignant par D+ et D- les opérateurs de dérivation à droite et à gauche.

On démontre que les conditions a, b, c, d ou (d′), déterminent ϕ de manière unique. Cette fonction se note Sp(f ) et s'appelle fonction spline cubique interpolant f à l'ordre p. Il faut cependant remarquer que le calcul explicite de ϕ nécessite la résolution d'un système d'équations linéaires assez compliqué. En revanche, la qualité de l'approximation est excellente :

– si f est de classe C1, on a :

– si f est de classe C2 :

– si f est de classe C3, alors, pour k ≤ 2 :

– enfin, si f est de classe C4, alors, pour k ≤ 3 :

Cependant, si f est de classe C∞, ou même polynomiale de degré ≥ 4, on ne peut pas améliorer la dernière estimation.

Un autre pôle d'intérêt des fonctions spline est relatif à leurs propriétés pour la norme quadratique. Plus précisément, si f est de classe C2, pour tout élément ϕ de S2,p([a, b]), on a :

La théorie des fonctions spline peut se généraliser aux spline d'ordre impair quelconque. Les propriétés d'approximation sont alors meilleures mais les calculs sont encore plus complexes que pour n = 3, si bien qu'elles sont peu utilisées en analyse numérique.

Accédez à l'intégralité de nos articles

- Des contenus variés, complets et fiables

- Accessible sur tous les écrans

- Pas de publicité

Déjà abonné ? Se connecter

Écrit par

- Jean-Louis OVAERT : agrégé de l'Université, ancien élève de l'École normale supérieure, professeur de mathématiques spéciales

- Jean-Luc VERLEY : maître de conférences honoraire à l'université de Paris-VII

Classification

Médias

Autres références

-

DARBOUX GASTON (1842-1917)

- Écrit par Jacques MEYER

- 320 mots

Mathématicien français, né à Nîmes et mort à Paris. Après des études à l'École normale supérieure, Darboux fut l'assistant de J. Bertrand à la chaire de physique mathématique au Collège de France (1866-1867), puis enseigna au lycée Louis-le-Grand (1867-1872) et à l'École normale...

-

DÉRIVÉES PARTIELLES (ÉQUATIONS AUX) - Analyse numérique

- Écrit par Claude BARDOS et Martin ZERNER

- 5 850 mots

- 7 médias

Du point de vue mathématique, les méthodes d'éléments finis sont une sous-famille des méthodes de Ritz-Galerkin. Pour les problèmes variationnels, ces méthodes consistent à remplacer l'espace V des fonctions admissibles par un de ses sous-espaces VN dit « espace d' approximation ». -

DIFFÉRENTIELLES ÉQUATIONS

- Écrit par Christian COATMELEC , Encyclopædia Universalis et Maurice ROSEAU

- 11 637 mots

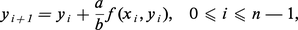

..., ..., yn), suite finie de n + 1 nombres réels telle que :où : ce problème Pn est obtenu en divisant I = [x0, x0 + a]en n parties égales avec un pas égal à h = a/n et en cherchant une approximation yi de y(xi) où y est la solution (lorsqu'elle est unique) de P1.

ce problème Pn est obtenu en divisant I = [x0, x0 + a]en n parties égales avec un pas égal à h = a/n et en cherchant une approximation yi de y(xi) où y est la solution (lorsqu'elle est unique) de P1.

-

GELFOND ALEXANDRE OSSIPOVITCH (1906-1968)

- Écrit par Jean-Luc VERLEY

- 165 mots

Alexandre Ossipovitch Gelfond est un mathématicien russe, né à Saint-Pétersbourg en 1906 et mort à Moscou en 1968. Le nom de Gelfond reste attaché à l'étude des nombres transcendants ; on lui doit aussi d'importants résultats sur l'interpolation et l'approximation des fonctions de variable complexe....

- Afficher les 14 références

Voir aussi

- CONVOLUTION PRODUIT DE

- LIMITE PROJECTIVE

- CONVERGENCE, mathématiques

- NORME, mathématiques

- LIMITE INDUCTIVE

- PRODUIT HERMITIEN

- PROJECTEUR, mathématiques

- FRACTION CONTINUÉE

- FOURIER SÉRIE DE

- APPLICATION RÉGULIÈRE

- CONVERGENCE DOMINÉE THÉORÈME DE LA

- CAUCHY FORMULE INTÉGRALE DE

- WEIERSTRASS THÉORÈME D'APPROXIMATION DE

- TAYLOR SÉRIE DE

- RADON MESURE DE

- SÉRIES ENTIÈRES

- FOURIER TRANSFORMATION DE

- HAAR THÉORÈME DE

- NOYAU, analyse mathématique

- APPROXIMATIONS SUCCESSIVES MÉTHODES DES

- ASCOLI THÉORÈME D'

- CAUCHY PROBLÈME DE

- SUITES, mathématiques

- DIRAC FONCTION DE

- CALCUL DIFFÉRENTIEL & INTÉGRAL

- ESCALIER FONCTION EN

- LAPLACE TRANSFORMATION DE

- ESPACE COMPLET

- ESPACE COMPACT

- BANACH-STEINHAUS THÉORÈME DE

- STABILITÉ, analyse numérique

- INTERPOLATION, mathématiques

- DUALITÉ, mathématiques

- RÉPONSE IMPULSIONNELLE

- CONSISTANCE, analyse numérique

- CONVERGENCE UNIFORME

- CONVERGENCE EN MOYENNE

- CONVERGENCE EN MOYENNE QUADRATIQUE

- CONVERGENCE SIMPLE

- CONVERGENCE RAPIDITÉ DE

- DISCRÉTISATION, mathématiques

- EULER MÉTHODE DU PAS À PAS D', analyse numérique

- DIFFÉRENCES CALCUL DES

- DINI THÉORÈME DE

- LAGRANGE INTERPOLATION DE

- HERMITE INTERPOLATION DE

- FUBINI THÉORÈME DE

- POISSON ÉQUATION DE

- QUASI ANALYTIQUE

- NOYAU INTÉGRAL

- NEWTON POLYNÔMES DE

- SOBOLEV ESPACE DE

- SOLUTION ÉLÉMENTAIRE

- SÉRIES DE FONCTIONS

- TCHEBYCHEV POLYNÔME DE

- SPLINE FONCTION

- APPROXIMATION

- EXPONENTIELLE FONCTION

- REPRÉSENTATION INTÉGRALE