- 1. Convergences usuelles en analyse

- 2. Représentations par des intégrales

- 3. Représentations par des séries

- 4. Approximation par des suites

- 5. Interpolation et discrétisation

- 6. Opérations sur les représentations et les approximations

- 7. Stabilité et consistance

- 8. Optimisation de l'approximation ; rapidité de convergence

- 9. Bibliographie

FONCTIONS REPRÉSENTATION & APPROXIMATION DES

Article modifié le

Stabilité et consistance

On peut décrire les procédés linéaires d'approximation par le schéma général suivant : soit E et F des espaces vectoriels normés de fonctions, et u une application linéaire continue de E dans F. Un processus linéaire d'approximation de u est une suite (un) d'applications linéaires continues de E dans F telles que, pour tout élément f de E, un(f ) converge vers u(f ).

Le cas le plus classique est celui où F = E et où u est l'application identique de E, c'est-à-dire où un(f ) converge vers f ; nous en avons fourni de nombreux exemples aux chapitres 4 et 5, les plus significatifs étant ceux des séries de Fourier et de l'interpolation de Lagrange. Le cas où F = C, c'est-à-dire où u est une forme linéaire sur E est aussi très intéressant (cf. analyse numérique).

Stabilité

Un des problèmes les plus importants, surtout pour l'analyse numérique, concerne la stabilité du processus (un) : si l'on fait une petite erreur sur la fonction f, c'est-à-dire si on remplace f par une fonction g proche de f dans E, un(g) converge-t-elle vers un élément proche de u(f ) ? La réponse est fournie par le résultat suivant.

Théorème 1. Caractérisation des processus stables.

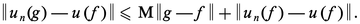

1. Si la suite (∥un∥) des normes des applications linéaires un est bornée par un nombre M indépendant de n, alors, pour tout couple (f, g) d'éléments de E :

2. Réciproquement, si (∥un∥) n'est pas bornée, alors, pour tout élément f de E, il existe une suite (gn) d'éléments de E qui converge vers f et telle que ∥un(gn) − u(f )∥ → + ∞.

C'est pourquoi, on dit que le processus (un) est stable dans le cas (1) et instable dans le cas (2).

En fait, ce résultat n'est pertinent que si les espaces normés E et F sont complets, car, si E n'est pas complet, E est un sous-espace dense d'un espace normé plus gros, à savoir son complété ; si bien que, en faisant une erreur sur f, on risque de passer à un élément g de Ê qui n'appartient pas à E. C'est le cas où, par exemple, Ê = C([a, b]) muni de la norme de la convergence uniforme et si E = Cp([a, b]). D'où l'intérêt du résultat suivant.

Théorème 1′. Stabilité et passage à un sous-espace vectoriel dense. Soit Ê et F des espaces de Banach et E un sous-espace dense de Ê. On considère une suite (un) d'applications linéaires continues de E dans F satisfaisant aux deux conditions suivantes :

a) pour tout f de E, un(f ) → u(f ) ;

b) la suite des normes (∥un∥) est bornée par M.

Alors u est linéaire continue sur E, ∥u∥ ≤ M, et les applications un et u se prolongent de manière unique en des applications linéaires continues de Ê dans F, qui satisfont aux conditions (a) et (b) sur Ê. Ainsi, le processus (un) est stable, non seulement sur E mais sur Ê.

Dans le cas où E est complet, il est tout à fait remarquable que la convergence implique la stabilité.

Théorème 2 (stabilité et complétude). Soit E et F des espaces de Banach, (un) une suite d'applications linéaires continues de E dans F telle que, pour tout x de E, la suite (un(x)) converge dans F vers u(x). Alors :

a) il existe M tel que ∥un∥ ≤ M ;

b) u est linéaire continue ;

c) un → u uniformément sur tout compact de E.

C'est le théorème de Banach-Steinhaus (cf. espaces vectoriels normés, chap. 4).

Le cas des séries de Fourier est à cet égard exemplaire ; c'est d'ailleurs un des exemples qui a été historiquement à l'origine du théorème général précédent. Ici E est l'espace vectoriel C(T) des fonctions continues 1-périodiques muni de la norme N∞ ; cet espace est complet ; un est la forme linéaire qui, à tout élément f de C(T), associe la valeur de la somme partielle sn(f ) de sa série de Fourier en un point donné x ; un(f ) n'est autre que Dn * f (x), où Dn est le noyau de Dirichlet.

On montre que :

Comme nous l'avons déjà vu au chapitre 5, un phénomène analogue se produit pour les processus interpolatoires.

En revanche, le processus d'approximation par les sommes partielles sn(f ) est stable sur (C(T), N2), et même sur (L2(T), N2) car ici sn est un projecteur orthogonal et ∥sn∥2 = 1. De même, si on prend les sommes de Fejer σn(f ) = Fn * f, alors ∥σn∥∞ = 1, ce qui assure la stabilité sur (C(T), N∞).

On observera que, dans ce dernier cas, le noyau est positif. Cette condition assure la stabilité de manière très générale.

Théorème 3. Continuité des opérateurs linéaires positifs. Soit u un endomorphisme de l'espace vectoriel C(T), ou C([a, b]), muni de la norme N∞. On suppose u positif, c'est-à-dire u(f ) ≥ 0 pour tout f ≥ 0. Alors u est continu ; plus précisément :

Autrement dit, ∥u∥ ≤ N∞(u(1)).

Si maintenant (un) est une suite d'opérateurs linéaires positifs qui converge simplement vers un opérateur u, auquel cas u est positif, alors la condition de stabilité est satisfaite pour un :

En outre, le théorème suivant assure la convergence du processus sous des hypothèses très faibles.

Théorème 4 (théorème de Korovkine). Soit (un) une suite d'endomorphismes positifs de C([a, b]) muni de la norme N∞ et u un endomorphisme de cet espace satisfaisant aux conditions suivantes : un(f ) → u(f ) uniformément sur[a, b]pour chacune des trois fonctions x ↦ 1, x ↦ x et x ↦ x2. Alors un(f ) → u(f ) pour toute fonction continue f.

Ce théorème fournit une nouvelle démonstration, due à Bernstein, du théorème d'approximation polynomiale de Weierstrass.

Théorème 5. On considère les polynômes de Bernstein :

Si à tout f ∈ C([a, b]) on associe la fonction polynomiale un(f ) définie par :

La convergence n'est pas très rapide car, si f est, par exemple, la fonction x ↦ x2, on a ∥un(f ) − f ∥ = 1/4 n.

D'ailleurs, l'approximation polynomiale par des opérateurs positifs un ne peut jamais être rapide, car on démontre que ∥un(f ) − f ∥∞ n'est pas négligeable devant 1/n2 pour l'une au moins des trois fonctions x ↦ 1, x ↦ x, x ↦ x2.

Enfin, le théorème de Korovkine s'étend aussitôt au cas des fonctions continues périodiques ; il suffit que la convergence de un(f ) vers f soit assurée pour les trois fonctions x ↦ 1, x ↦ cos2 πx, x ↦ sin2 πx. On retrouve ainsi la convergence uniforme des sommes de Fejer σn(f ) pour toute fonction continue périodique ; ici encore la convergence est lente car ∥σn(f ) − f ∥∞ est exactement de l'ordre de 1/n lorsque f (x) = |cos2 πx|.

Consistance

Dans de nombreux exemples, le processus d' approximation (un) d'une application u de E dans F se présente sous la forme suivante : on se donne une suite (En) de sous-espaces vectoriels de dimension finie d'un espace vectoriel normé E de fonctions telle que

Un cas particulièrement important est celui où un est défini à partir d'une suite (pn) de projecteurs de E sur En grâce à la relation un = u ∘ pn. Si E = F = C(T) muni de la norme N2 et si En = Tn est l'espace vectoriel des polynômes trigonométriques de degré ≤ n, on peut prendre pour pn le projecteur orthogonal de E sur En. Il en est de même si E = F = C([a, b]), muni de la norme :

Lorsque E = F = C([a, b]) muni de la norme N∞ et En = Pn, les interpolations de Lagrange ou, plus généralement, d'Hermite constituent aussi des exemples significatifs.

Pour étudier la convergence des processus consistants, l'idée est de comparer un(f ) à un élément ϕn(f ) approchant f le mieux possible. Plus précisément, on note δn(f ) la distance d'un élément f de E à En, définie par :

Comme En est de dimension finie, il existe au moins un élément ϕn ∈ En tel que ∥f − ϕn∥ = d(f, En) ; on dit alors que ϕn optimise l'approximation de f par les éléments de En. L'étude de ce problème est abordée au chapitre 8.

Dans ces conditions, comme un(ϕn) = u(ϕn),

Le problème de la convergence du processus (un) et de sa rapidité de convergence est alors séparé en deux questions totalement distinctes :

– l'évaluation de δn(f ) qui est liée à la régularité de la fonction que l'on veut approcher ;

– l'évaluation de ∥un∥ qui mesure la qualité du processus d'approximation.

Accédez à l'intégralité de nos articles

- Des contenus variés, complets et fiables

- Accessible sur tous les écrans

- Pas de publicité

Déjà abonné ? Se connecter

Écrit par

- Jean-Louis OVAERT : agrégé de l'Université, ancien élève de l'École normale supérieure, professeur de mathématiques spéciales

- Jean-Luc VERLEY : maître de conférences honoraire à l'université de Paris-VII

Classification

Médias

Autres références

-

DARBOUX GASTON (1842-1917)

- Écrit par Jacques MEYER

- 320 mots

Mathématicien français, né à Nîmes et mort à Paris. Après des études à l'École normale supérieure, Darboux fut l'assistant de J. Bertrand à la chaire de physique mathématique au Collège de France (1866-1867), puis enseigna au lycée Louis-le-Grand (1867-1872) et à l'École normale...

-

DÉRIVÉES PARTIELLES (ÉQUATIONS AUX) - Analyse numérique

- Écrit par Claude BARDOS et Martin ZERNER

- 5 850 mots

- 7 médias

Du point de vue mathématique, les méthodes d'éléments finis sont une sous-famille des méthodes de Ritz-Galerkin. Pour les problèmes variationnels, ces méthodes consistent à remplacer l'espace V des fonctions admissibles par un de ses sous-espaces VN dit « espace d' approximation ». -

DIFFÉRENTIELLES ÉQUATIONS

- Écrit par Christian COATMELEC , Encyclopædia Universalis et Maurice ROSEAU

- 11 637 mots

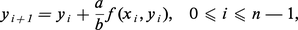

..., ..., yn), suite finie de n + 1 nombres réels telle que :où : ce problème Pn est obtenu en divisant I = [x0, x0 + a]en n parties égales avec un pas égal à h = a/n et en cherchant une approximation yi de y(xi) où y est la solution (lorsqu'elle est unique) de P1.

ce problème Pn est obtenu en divisant I = [x0, x0 + a]en n parties égales avec un pas égal à h = a/n et en cherchant une approximation yi de y(xi) où y est la solution (lorsqu'elle est unique) de P1.

-

GELFOND ALEXANDRE OSSIPOVITCH (1906-1968)

- Écrit par Jean-Luc VERLEY

- 165 mots

Alexandre Ossipovitch Gelfond est un mathématicien russe, né à Saint-Pétersbourg en 1906 et mort à Moscou en 1968. Le nom de Gelfond reste attaché à l'étude des nombres transcendants ; on lui doit aussi d'importants résultats sur l'interpolation et l'approximation des fonctions de variable complexe....

- Afficher les 14 références

Voir aussi

- CONVOLUTION PRODUIT DE

- LIMITE PROJECTIVE

- CONVERGENCE, mathématiques

- NORME, mathématiques

- LIMITE INDUCTIVE

- PRODUIT HERMITIEN

- PROJECTEUR, mathématiques

- FRACTION CONTINUÉE

- FOURIER SÉRIE DE

- APPLICATION RÉGULIÈRE

- CONVERGENCE DOMINÉE THÉORÈME DE LA

- CAUCHY FORMULE INTÉGRALE DE

- WEIERSTRASS THÉORÈME D'APPROXIMATION DE

- TAYLOR SÉRIE DE

- RADON MESURE DE

- SÉRIES ENTIÈRES

- FOURIER TRANSFORMATION DE

- HAAR THÉORÈME DE

- NOYAU, analyse mathématique

- APPROXIMATIONS SUCCESSIVES MÉTHODES DES

- ASCOLI THÉORÈME D'

- CAUCHY PROBLÈME DE

- SUITES, mathématiques

- DIRAC FONCTION DE

- CALCUL DIFFÉRENTIEL & INTÉGRAL

- ESCALIER FONCTION EN

- LAPLACE TRANSFORMATION DE

- ESPACE COMPLET

- ESPACE COMPACT

- BANACH-STEINHAUS THÉORÈME DE

- STABILITÉ, analyse numérique

- INTERPOLATION, mathématiques

- DUALITÉ, mathématiques

- RÉPONSE IMPULSIONNELLE

- CONSISTANCE, analyse numérique

- CONVERGENCE UNIFORME

- CONVERGENCE EN MOYENNE

- CONVERGENCE EN MOYENNE QUADRATIQUE

- CONVERGENCE SIMPLE

- CONVERGENCE RAPIDITÉ DE

- DISCRÉTISATION, mathématiques

- EULER MÉTHODE DU PAS À PAS D', analyse numérique

- DIFFÉRENCES CALCUL DES

- DINI THÉORÈME DE

- LAGRANGE INTERPOLATION DE

- HERMITE INTERPOLATION DE

- FUBINI THÉORÈME DE

- POISSON ÉQUATION DE

- QUASI ANALYTIQUE

- NOYAU INTÉGRAL

- NEWTON POLYNÔMES DE

- SOBOLEV ESPACE DE

- SOLUTION ÉLÉMENTAIRE

- SÉRIES DE FONCTIONS

- TCHEBYCHEV POLYNÔME DE

- SPLINE FONCTION

- APPROXIMATION

- EXPONENTIELLE FONCTION

- REPRÉSENTATION INTÉGRALE